Быстрое развитие технологий искусственного интеллекта дало впечатляющие результаты в области генерации видео и изображений. Последний пример — исследование компании NVIDIA, показывающее, как созданные с помощью ИИ визуальные эффекты можно комбинировать с традиционным конвейером растеризации. В результате получается гибридная графическая система, которую можно было бы использовать в играх, фильмах и виртуальной реальности.

«Это новый способ воспроизведения видеоконтента с использованием глубинного обучения, — отметил вице-президент NVIDIA по прикладному машинному обучению Брайан Катандзаро (Bryan Catanzaro) в беседе с журналистами The Verge. — Разумеется, NVIDIA активно думает о генерации графики, и мы исследуем вопрос, как ИИ может совершить революцию в этой области».

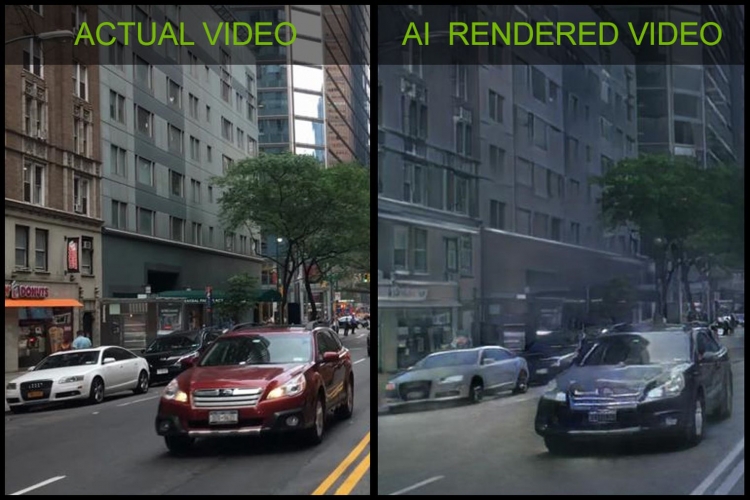

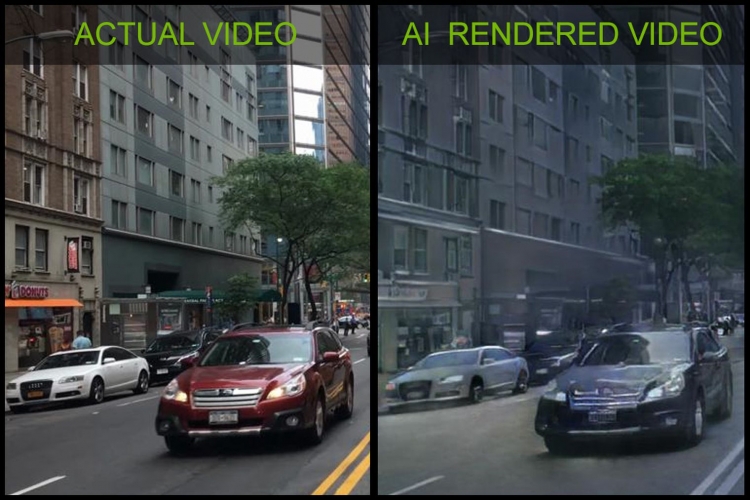

Результаты работы NVIDIA не смотрятся пока фотореалистичными и демонстрируют типичные артефакты, характерные для многих изображений, создаваемых искусственным интеллектом. Да и сама технология не является чем-то принципиально новым и в чём-то похожа на алгоритм превращения заваленных снегом улиц в летние, разработанный в NVIDIA для более эффективного обучения автопилота.

В исследовательской работе инженеры компании объясняют, что они основывались на ряде существующих методов, включая популярную систему с открытым исходным кодом под названием pix2pix. Используется метод генеративно-состязательной сети (GAN), который активно применяется для формирования визуальных данных. Он построен на комбинации из двух нейронных сетей, одна из которых генерирует образцы, а другая отклоняет неточные по её мнению. В результате ИИ самообучается созданию всё более качественных результатов с течением времени. Этот подход применяется довольно широко в индустрии создания изображений самого разного рода: от поддельных лиц знаменитостей до картины, которая недавно была продана на аукционе за $432 000.

Но NVIDIA представила ряд новшеств, и один из результатов проделанной работы — создание первой игровой демонстрации с генерируемой при помощи ИИ графикой. Речь идёт о простом симуляторе вождения, где игроки перемещаются по нескольким городским районам, генерируемым ИИ, но не могут покинуть свой автомобиль или иным образом взаимодействовать с миром. Демонстрация работает на одном графическом процессоре — заметное достижение для такой перспективной работы. Впрочем, стоит признать, что речь идёт о Titan V за $3000, который обычно используется для продвинутой симуляции, а не для игр.

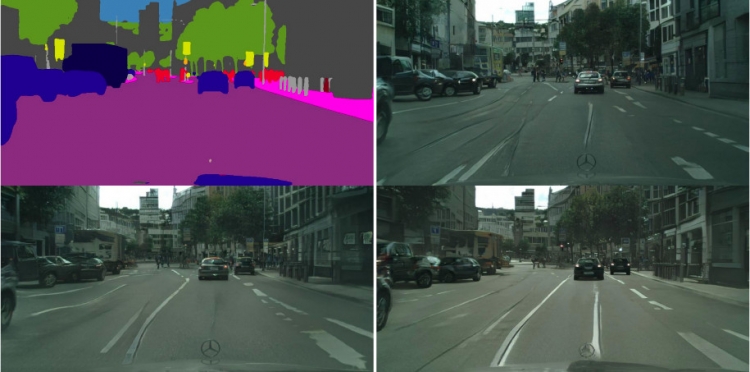

Технология NVIDIA генерирует графику в несколько шагов. Вначале исследователи должны собрать данные для обучения: в данном случае это были материалы, используемые при разработке автопилота. Затем видео сегментируется: каждый кадр разбивается на категории вроде неба, автомобилей, деревьев, дороги, зданий и так далее. Затем GAN обучается на основе этих данных для последующей генерации новых объектов.

После этого исследователи создали базовую топологию виртуальной среды, используя традиционный игровой движок. В данном случае речь шла об Unreal Engine 4, который применяется в массе проектов вроде Fortnite, PUBG, Gears of War 4 и других. Используя эту среду в качестве основы, алгоритмы машинного обучения генерируют графику для каждой категории предметов в реальном времени, вставляя их поверх моделей игрового движка.

«Структура мира создаётся традиционным методом, — отметил господин Катандзаро, — единственное, что генерирует ИИ, — это графика». Он также сказал, что сама демонстрация является весьма простой и была собрана воедино лишь одним инженером, добавив: «Она призвана выступить в качестве доказательство концепции, а не быть полноценной интересной игрой».

Чтобы создать эту систему, инженеры NVIDIA должны были решить ряд задач, самой главной из которых было сохранить постоянство создаваемых алгоритмом объектов. Проблема в том, что алгоритм глубинного обучения генерируют графику с высокой частотой кадров, так что первоначальные результаты работы алгоритма были неудобоваримы из-за изменений цветов и текстур в каждом кадре. Пришлось создать систему кратковременной памяти для сравнения каждого нового кадра с предыдущим. Она также призвана предсказывать направление движения и затем создавать кадры, согласованные с существующими. Все эти вычисления весьма требовательны к ресурсам, потому игровая демонстрация выводит лишь 25 кадров/с.

Технология, разумеется, находится на очень ранней стадии, но в отдалённой перспективе легко представить будущее, где реализм в играх достигается в том числе с помощью подобных алгоритмов, использующих фотореалистичную генерацию на основе объектов реального мира. NVIDIA отмечает, что трассировка лучей, например, десятилетиями использовалась в различных областях 3D-графики пока, наконец, не добралась до игр. Технология может также использоваться при создании окружений для тренировки роботов, автопилота и в других областях. В перспективе метод также может найти и злонамеренное применение — например, для создания подделок.