Исследователи Microsoft и Массачусетский технологический институт (MIT) разработали систему, которая позволит выявлять ошибки в знаниях искусственного интеллекта, используемого для автономного управления движением автомобилей и или действиями роботов.

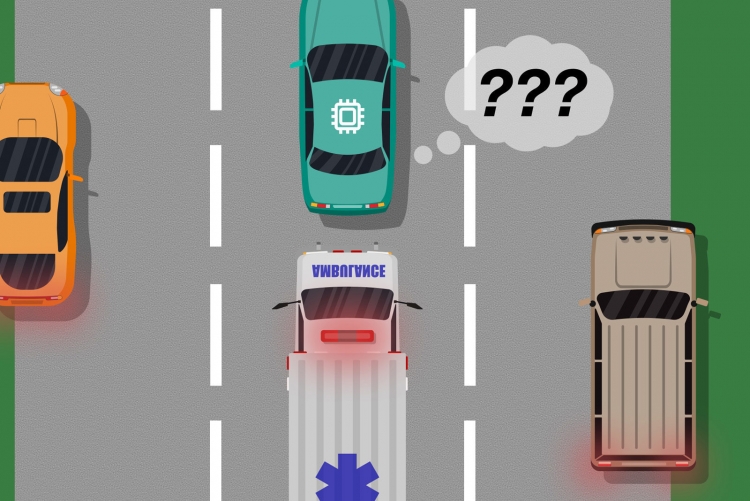

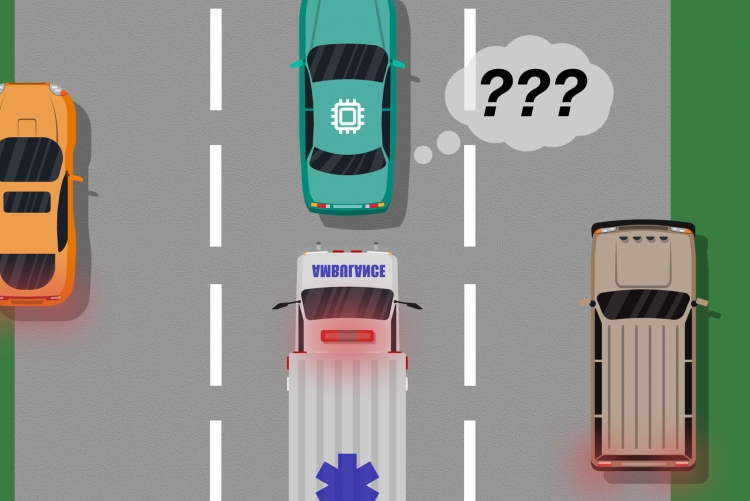

Эти пробелы, называемые «слепыми пятнами», возникают, когда имеются значительные различия между примерами обучения ИИ и тем, что человек будет в реальности делать в определённой ситуации. Например, когда самоуправляемый автомобиль не обнаруживает разницы между большим белым автомобилем и машиной скорой помощи с сиреной, и, следовательно, не ведёт себя должным образом.

Новая модель, разработанная MIT и Microsoft, оснащена системой искусственного интеллекта, сравнивающей реальные действия человека с тем, что может быть сделано этой же ситуации. В качестве альтернативы в режиме реального времени человек, наблюдающий за ИИ, может исправить любые ошибки по мере их возникновения или непосредственно перед этим. В результате система искусственного интеллекта изменит своё поведение в зависимости от того, насколько близки её действия к действиям человека, и определит ситуации, для которых требуется большего понимания.

«Модель помогает автономным системам лучше узнать, что именно они не знают, — рассказал автор исследования Рамья Рамакришнан (Ramya Ramakrishnan). — Неоднократно при развёртывании этих систем полученные в результате моделирования навыки не соответствовали реальной обстановке [и] они могли совершать ошибки, такие как попадание в аварии. Идея состоит в том, чтобы использовать людей для безопасного преодоления этого разрыва между моделированием и реальным миром, что позволило бы нам уменьшить число этих ошибок».

Новая система пока не готова к публичному запуску — её тестировали лишь в видеоиграх. Следующий этап — её использование с реальными самоуправляемыми автомобилями и их тестируемыми системами.